- 0

- 0

- 0

分享

- 8张3090,1天压缩万亿参数大模型!3.2TB骤降至160GB,压缩率高达20倍

-

2023-10-31

新智元报道

新智元报道

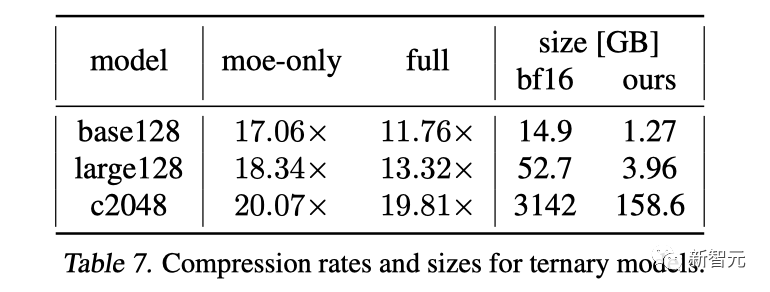

【新智元导读】最近,来自ISTA的研究人员提出了一种全新的模型量化方法QMoE,可以将1.6万亿个参数的SwitchTransformer压缩到160GB以下(每个参数0.8位),且精度损失很小。

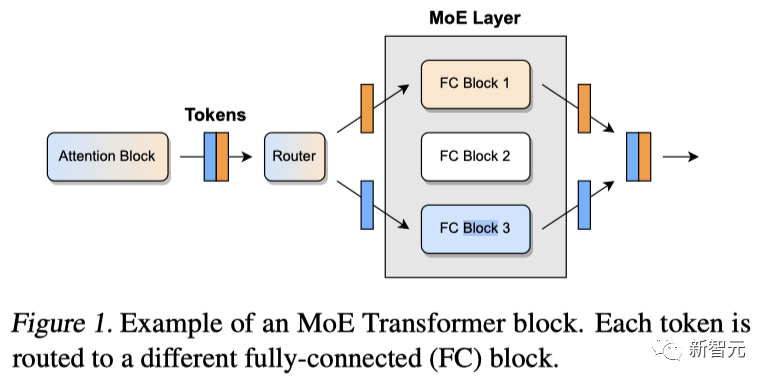

MoE模型量化

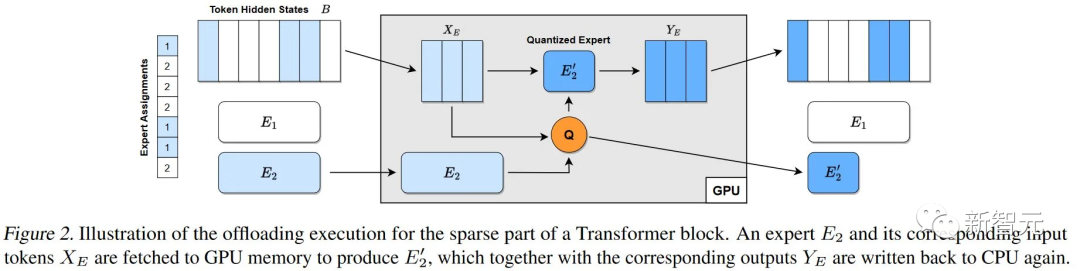

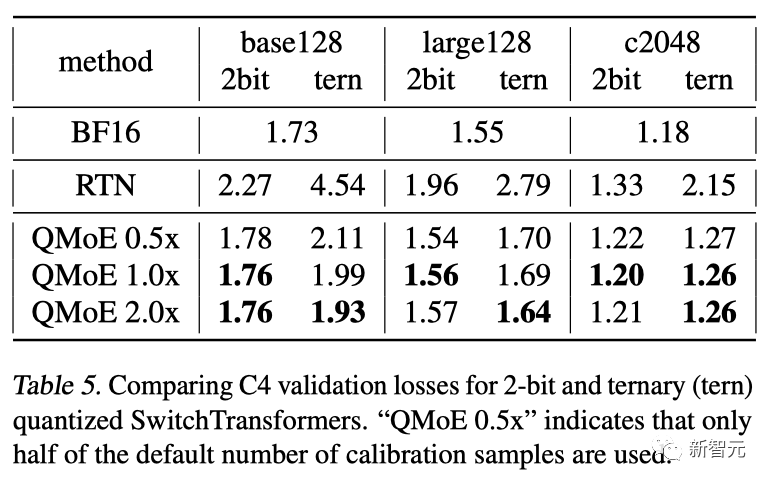

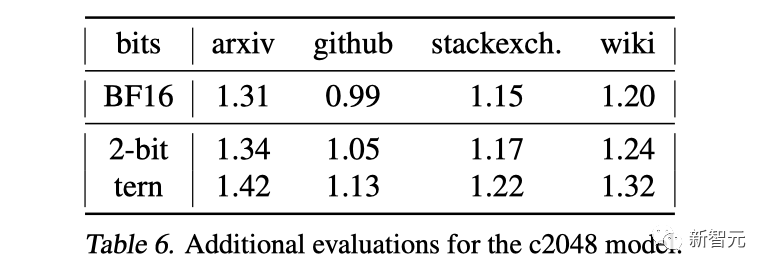

压缩效果

精度

压缩

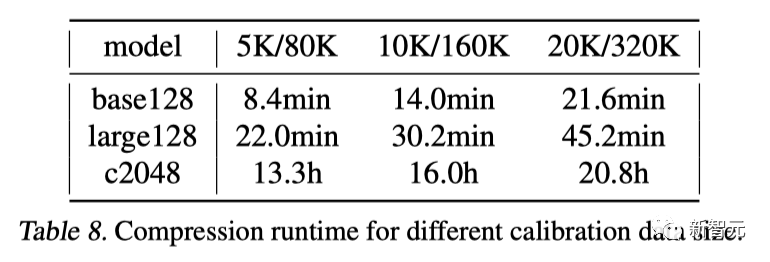

运行时间

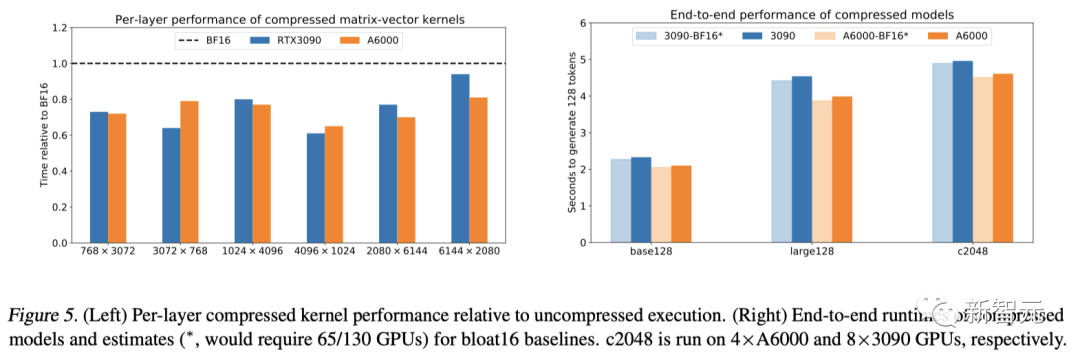

运行结果

讨论与局限性

-

阅读原文

* 文章为作者独立观点,不代表数艺网立场转载须知

- 本文内容由数艺网收录采集自微信公众号新智元 ,并经数艺网进行了排版优化。转载此文章请在文章开头和结尾标注“作者”、“来源:数艺网” 并附上本页链接: 如您不希望被数艺网所收录,感觉到侵犯到了您的权益,请及时告知数艺网,我们表示诚挚的歉意,并及时处理或删除。