- 0

- 0

- 0

分享

- 面向安全的智能汽车信息与交互设计研究

-

原创 2022-11-14

内容摘要

内容摘要:安全问题是智能汽车设计与交互设计的基本问题。文章以智能汽车为对象,在提出面向安全的智能汽车信息与交互设计框架的基础上,基于智能汽车的情境和人因问题,围绕智能汽车的安全交互设计和告警信息设计,分析信息与交互设计要素,并通过案例研究,提出设计策略与建议,指导智能汽车的安全设计。

关键词:智能汽车、信息与交互设计、安全

引言

2007年,全球第一台自动驾驶汽车完成实际道路的测试[1]以来,智能汽车已经逐步成为汽车发展的主要方向。智能汽车可以提升交通效率、减少环境污染并消除约90%的交通事故,在全面应用后每年可以挽救约100万人的生命。[2]然而,从设计的角度看,智能汽车的设计还存在着诸多挑战,特别是在经典的汽车交互体验设计的基础上,围绕人与人工智能的交互和信息设计,出现了诸多全新的涉及驾乘安全的问题,已经成为设计学研究的重要方向之一。

1

面向安全智能汽车设计研究框架

安全问题历来是汽车设计的关键问题。在工业设计领域,汽车的安全设计长期以来围绕驾驶员展开,集中在基于人体尺寸的驾驶空间设计和基于认知心理的汽车人机交互界面设计两个领域。[3-4]随着人工智能技术在汽车领域的应用,汽车的智能系统已经可以部分甚至完全接管人的驾驶任务,人车共驾和自动驾驶逐步成为未来智能汽车的主要情境。[5]在这样的背景下,智能汽车的信息与交互设计正在发生着本质性的改变,特别是在新人车关系下的安全问题,对智能汽车设计具有重要意义。

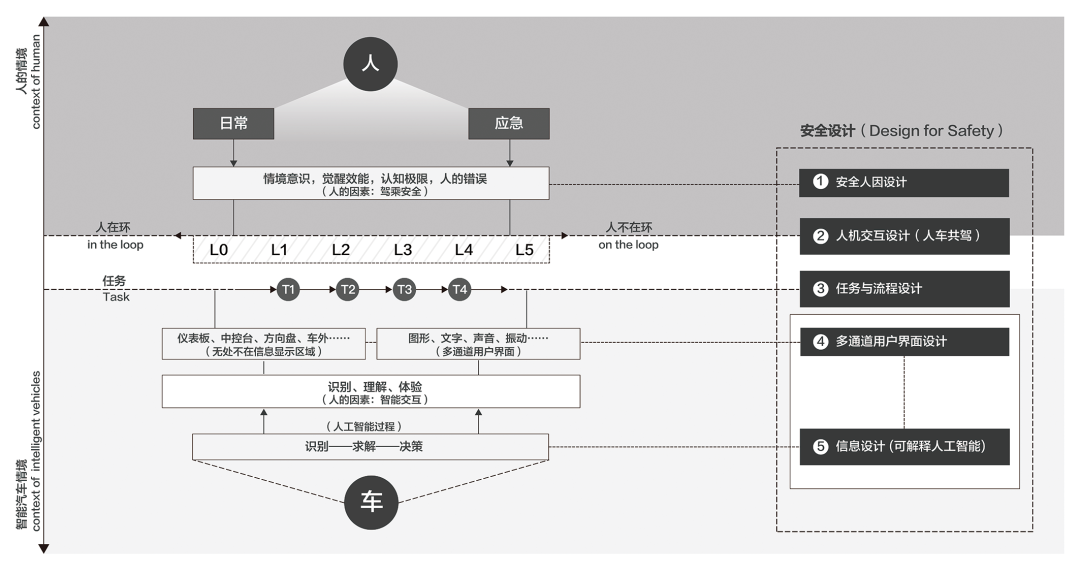

基于安全的智能汽车信息与交互设计涉及包含设计学在内的多个学科,如人工智能、计算机、安全科学、心理学、车辆工程等。其研究背景是人与智能汽车共同协作过程中,人的感知和执行能力极限以及人的错误可能对人车系统的总体安全造成影响。从经典交互设计的角度看,人的因素(Human Factors)是智能汽车信息与交互设计的主要内容;从安全设计的角度,围绕日常和应急两个基本情境,研究诸如情境意识、觉醒效能、认知极限、人的错误等人因问题。

同时,基于智能汽车自主性带来的设计挑战,面向人与智能汽车功能分配和人车共驾过程中的接管移交等问题展开人机交互设计。在智能汽车信息与界面设计方面,除了传统的车内显示和控制装置的交互与界面设计外,围绕确保信息交互安全的智能系统的识别、解释、体验展开设计研究,并考虑人的不同的感知与交互通道,以及相关的多通道用户界面的设计。基于安全的智能汽车信息与交互设计的研究框架如图1所示。

图1.基于安全和安全体验的智能汽车信息与交互设计研究框架

2

智能人车交互情境与安全人因问题

汽车设计的安全问题主要来自于人车交互情境的复杂性与人的生理心理行为的不适应性。智能汽车的信息与交互设计的核心就是围绕复杂的人车交互情境,基于人的情境意识和觉醒状态,通过设计避免超过人的生理心理极限的信息交互,减少人的错误,减少或避免事故发生。

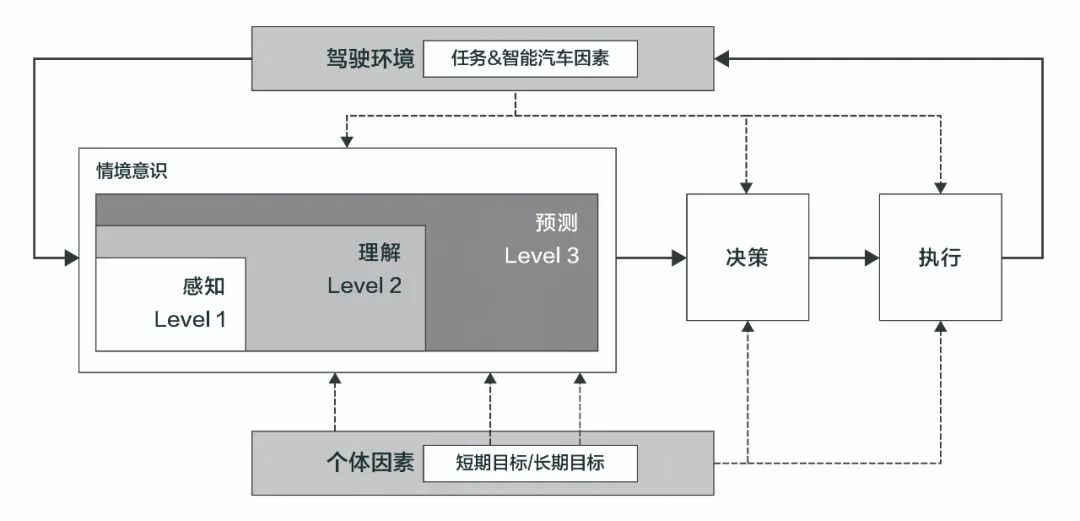

根据沃克尔(Walker G. H.)等人的研究,人在车中执行的各类任务超过1600个。[6]在智能驾乘和出行的背景下,人与智能汽车交互的复杂性仍在快速上升。情境的复杂性决定了车内的人需要对情境的变化进行理解,即情境意识(Situation Awareness)。情境意识是指用户对环境中动态变化的内容的意识,它解释了用户如何管理驾驶的长期目标(如到达目的地)和短期目标(如避免事故、娱乐通讯等)之间的关系。例如一边开车一边打电话的情境,虽然用户视线还是集中于前方道路,但是因为用户的情境意识并不在驾驶情境中,而在电话内容的情境中,所以容易发生交通事故。基于恩兹利(Endsley M. R.)等的相关研究[7],情境意识可以分为感知、理解和预测三个层次,同时考虑个体因素和环境因素等。(图2)在智能驾驶,特别在自动驾驶的情况下,人已经完全不需要监控汽车,大多数时候可能在做与驾驶无关的事情。因此,从“非驾驶任务”的状态进入到“驾驶任务”状态的情境意识变化,更容易造成安全事故,是汽车安全设计需要关注的问题。

图2.情境意识机制的三个层次

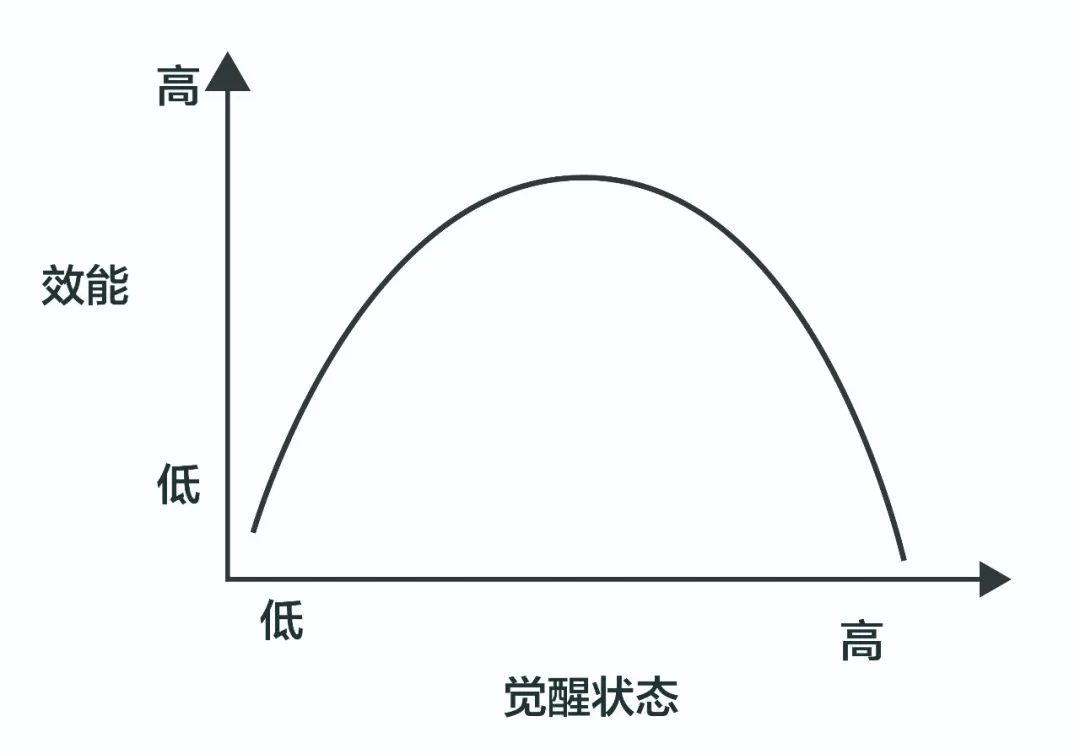

基于安全科学理论,面向安全的智能汽车人机交互情境主要包含日常情境和应急情境。日常情境是智能汽车正常行驶的情境;应急情境是发生危及汽车、乘员和行人安全的情境。不论是日常监控还是应急响应,都与人的觉醒状态密切相关。觉醒状态是指人从瞌睡到高度紧张之间的生理心理状态,包括安静、松弛、紧张、警惕、兴奋等常见的个体活动状态。[8]在驾驶过程中,各类情况出现的频率高低决定了人的“觉醒状态”的变化。发生情况频率低时,人处于单调的警觉状态;随着频率增加,人的觉醒水平也不断提高并可维持一定的警觉状态;长期的高频率应急刺激,可以让驾驶人员的日常监控超过人的生理心理承受范围,导致倦怠和疲劳的产生。如图3所示,用户只有在中等水平觉醒状态下才能灵敏地感知环境的变化,并以适当的行为适应环境的各种变化。因此,如何在智能驾驶的情况下保持用户合理的觉醒状态对于驾驶安全具有重要意义。

图3.觉醒-效能曲线

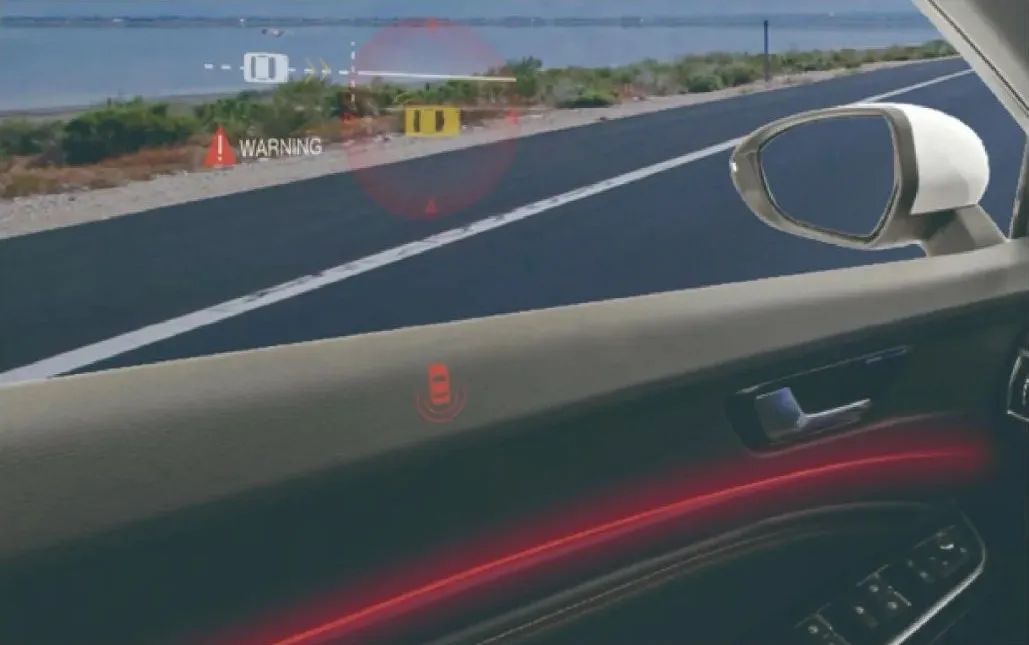

人的认知和脑力作业(感知、分析、决策和执行等)的能力始终是有限的。然而,驾驶又是一项复杂任务,很多时候需要完成若干个并发驾驶任务,还可能同时进行大量其他活动,如听音乐、打电话等。这样就很容易超出人的信息加工能力极限,造成安全问题。因此,智能汽车信息与交互设计的核心问题之一在于避免非驾驶任务的信息过多出现在人的信息加工与脑力作业过程中,影响人的正常驾驶行为。例如奔驰2019款GLA智能汽车的平视显示(HUD)界面设计上,仅保留了导航信息直接相关的重要信息,严格控制出现在用户视野中的信息数量(图4),以确保驾驶安全。

图4.奔驰2019款CLA智能汽车平视显示,图片来源:https://group-media.mercedes-benz.com

智能汽车安全设计还要考虑人的错误。西蒙(H. A. Simon)认为人是“有限理性”的[9],也就是人总是会犯错误的。根据世界卫生组织的数据,全球交通事故中大约90%是人为错误造成的。[10]很多人在出现差错的时候总是埋怨自己,但是,人出现的差错是各种因素综合的结果。例如人在紧急情况下误读仪表通常是由于用户在紧张的情况下,出现了慌乱的内部心理状态;同时汽车仪表显示不当,造成用户认读或快速理解上的困难。事实上,多数人为差错不是由于人不负责任的行为造成的,而是不好的设计造成的。

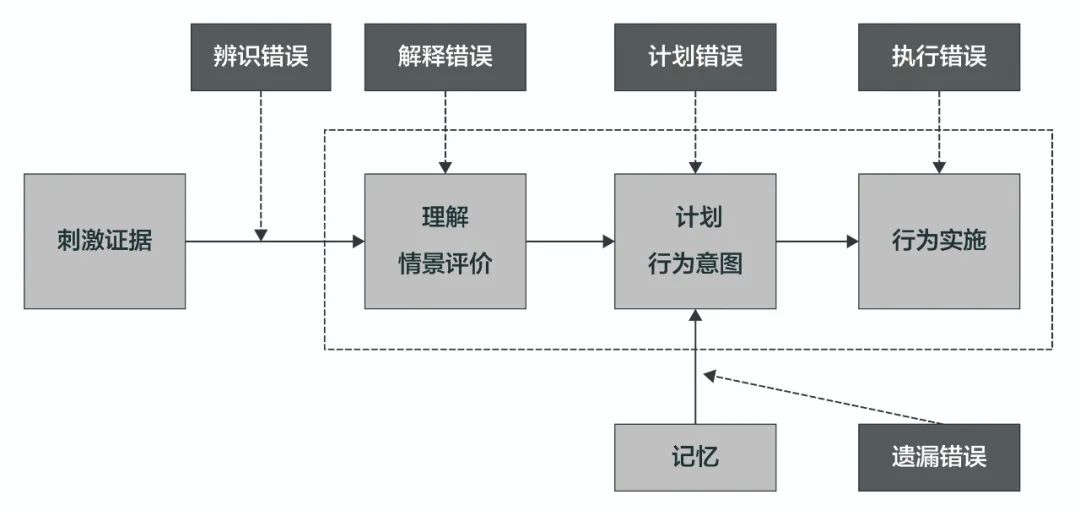

从人的信息加工和驾驶行为的角度,可以把人的错误分为五类:辨识错误、理解错误、计划错误、遗漏错误和执行错误,如图5。不同的错误,采用的信息交互设计策略有所不同。例如针对理解错误,就需要注重信息可解释和信息可视化设计;而针对遗漏错误,则应该在用户执行某个必要行为却未执行的时候,对用户进行提醒或者由智能汽车主动完成相关的任务。

图5.人的错误类型

3

智能汽车的自主性与安全交互设计

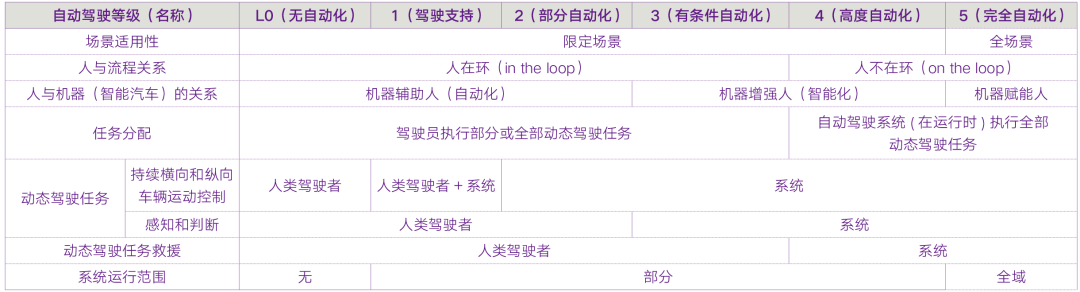

从智能设计的角度看,智能汽车在安全方面的挑战主要来源于汽车的自主(Autonomy)行为,即智能汽车根据任务的需要,“主动地”完成驾驶过程中原来需要人来完成的任务。智能汽车的自主性正在深刻改变着人与汽车的关系。国际汽车工程学会将不同的汽车自主行为分为了从L0到L5六个等级[11],分别表示从人类完全控制汽车到智能系统完全控制汽车的情境。(表1)从人与驾驶行为的关系看,在自动化等级L0-L3,人在整个驾驶流程中是不可或缺的,因此人在流程中,即“人在环”(in the loop);而到了自动化等级L4和L5,人就可以从流程中解脱出来,主要承担监管和辅助任务,甚至不进行任何操作,因此人在流程外,即“人不在环”(on the loop)。

表1.智能汽车的自动化等级(基于SAEJ3016-2016整理)

从表1中可以看出,只要人在环,汽车的操作、决策和执行功能都需要由人来完成的,人在人车系统中总是处于主导地位,智能汽车主要是辅助作用。因此其安全设计首先确保人的正确操作、决策,避免认为错误。如果人不在环,智能汽车的安全主要受到智能汽车自身的影响,因为不在环的情况下智能汽车已经可以独立完成全部任务。在这种情况下,智能机器和系统一般可以处于独立执行的地位。但不可避免的是,智能汽车的主导也会导致人的控制权的丧失,进而出现安全感知与体验的明显下降。一个代表性的案例就是人们对飞机事故预期危险感知与飞机乘客几乎完全没有控制权有密切关系,即缺乏“感知可控性”。因此,一般情况下,为了保证不在环人的感知体验,在设计中,用户还是需要保留监控以及实时介入的能力,确保对智能汽车的控制。但这会带来诸多的安全挑战,特别是在控制权接管和移交的交互过程中。

人机分配是经典的交互设计问题,也就是将智能汽车和人的功能进行分配,以决定哪些功能由人完成,哪些功能由智能汽车完成。人机分配取决于人与智能汽车的合作模式和用户意图,保证了人与智能汽车对环境的行动之间的一致性。具体到人机功能分配中,最关键的就是充分发挥人与智能汽车的特长,扬长避短。人机功能分配主要有几个主要原则:比较分配原则、剩余分配原则和弹性分配原则等。比较分配原则是通过对人与智能汽车的特性进行比较,然后以此为依据进行功能分配。人与智能汽车各有其优势和局限性,需要相互补充。一般来说,强度大的、快速紧急的、高精度的、持续久的、单调的或操作环境恶劣的工作,要安排智能汽车去完成。应付并不紧急的突发情况、排障维修等工作可以多考虑由人去完成。剩余分配原则是指把尽量多的功能分配给智能汽车,剩余的功能分配给人。这样的分配原则可能使智能汽车分配功能过多,造成人失去控制权。弹性分配原则是一种宜人的人机分配原则。根据弹性分配原则,人可以自己选择参与系统行为的程度,功能分配具有很大的弹性。例如现代民航客机,飞行员可以在自动飞行、手控飞行上做多种选择。[12]从智能汽车的角度看,人与智能汽车的功能分配呈现出一种弹性分配的特点。一方面,需要持续进行人车之间行动过程和可用资源的判断,自动选择最好的资源;另一方面,需要开展系统状态之间的转换,进行任务和责任的重新分配。

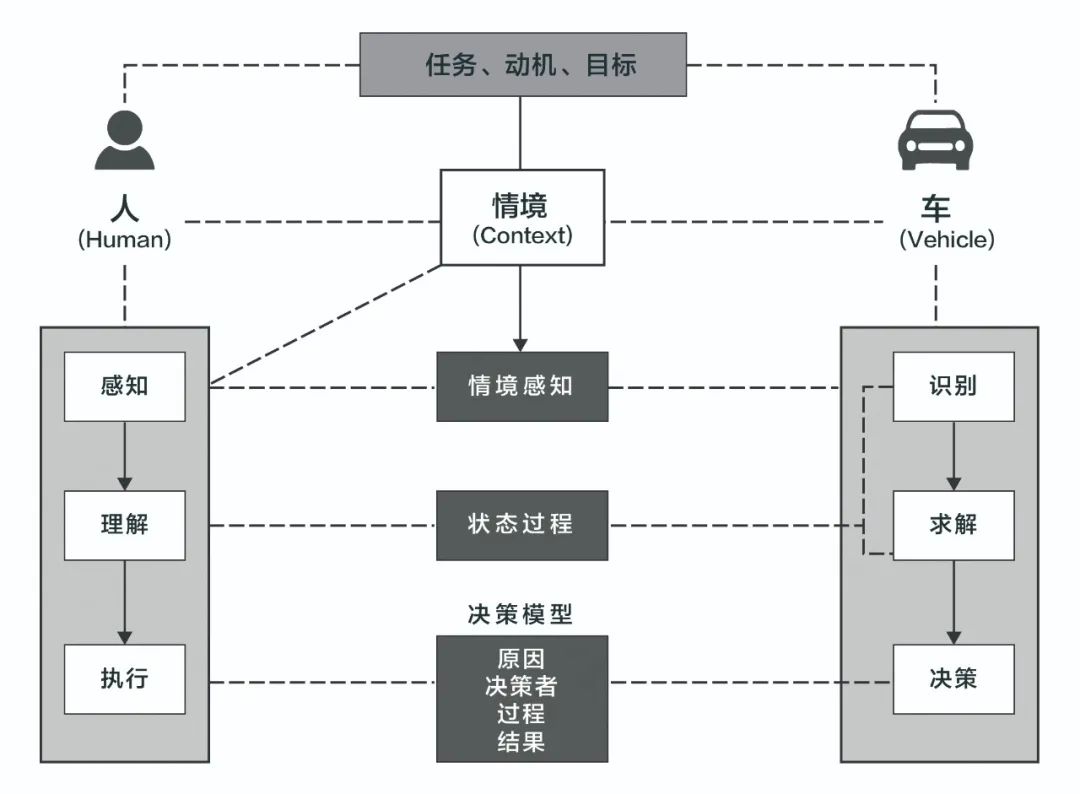

人车共驾是一种更为灵活的人机功能分配。不论人是否在环,人车共驾的本质是人的思维与推理行为与智能汽车的认知行为的配合,即让不同人的认知过程与智能汽车的认知过程协同配合。在这个过程中,人与智能汽车在某个情境中,围绕共同的任务、动机、目标来开展人车共驾行为。情境感知、状态理解和决策模型分别对应着人与智能汽车的感知与识别、理解与求解、决策与执行三个主要的阶段。(图6)

图6.人车共驾的模式

人与智能汽车人车共驾的协作模式是智能汽车交互的核心。当人在环的时候,协作模式为辅助驾驶。在辅助模式下,用户进行操作,智能汽车辅助,但汽车可以警告用户类似超速等行为。目前的自适应巡航的交互设计就是代表案例。[13]在辅助驾驶中有一类辅助被称为增强驾驶感知,即向人提供驾驶过程中无法感知或难以感知的信息,如增强现实显示等。当人不在环的时候,人车共驾呈现弹性关系,既可以由人来操作,也可以由智能汽车来操作。最为代表性的交互模式就是所谓的“相互控制模式”,即人与智能汽车以不同的介入水平相互控制。

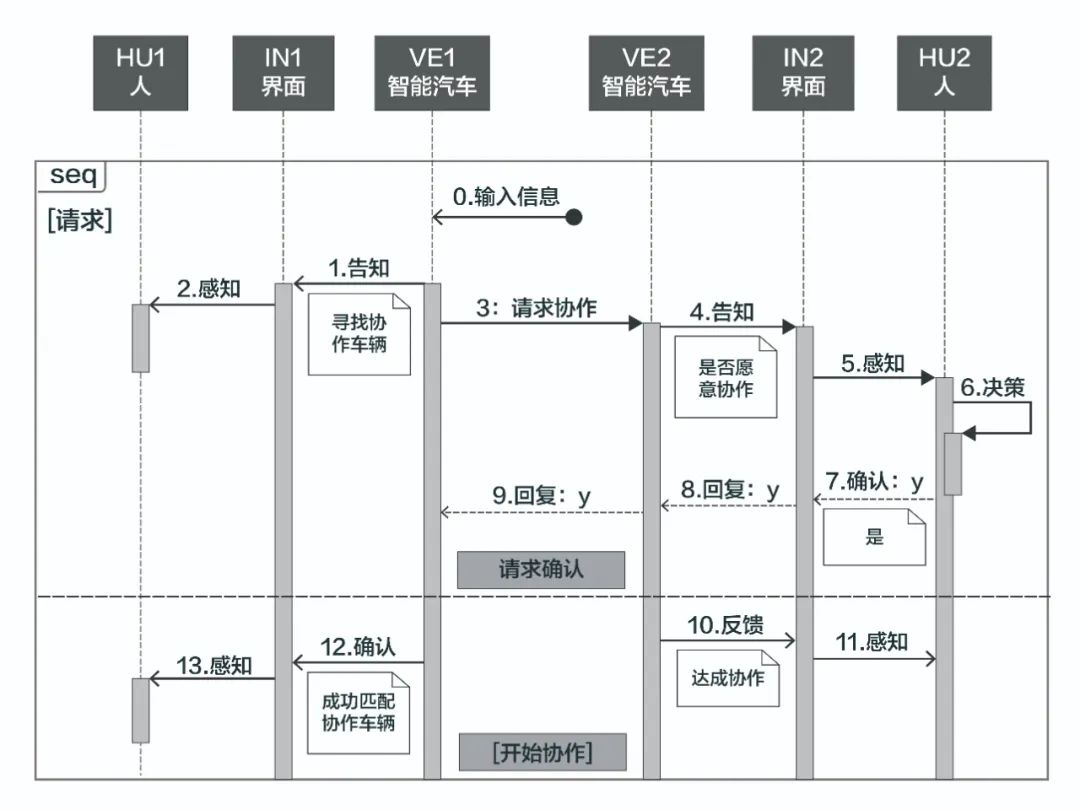

从交互设计的角度讲,相互控制模式的核心在于在不同的弹性情况下,如何由智能汽车主动实施交互。相互控制模式可以分为警告模式(解释信息传输,例如“如何警告超速”)、行动建议模式(智能汽车对人的操作提出建议)和限制模式(禁止人开展某种危及行车安全的任务等)。与警告模式和限制模式相比,行动建议具有很好的灵活性,使得人与智能汽车都有操作可能性,提高了技术的安全性和接受度,是常用的人车协同方式。在实际情境中,还存在多人与多车弹性合作的人车共驾情境。如图7就是齐默尔曼(M. Zimmermann)等的关于两名用户与两台智能汽车合作“变换车道”的流程示意图。[14]

图7.人与智能汽车合作变化车道示意图

4.智能汽车接管移交的流程与交互设计

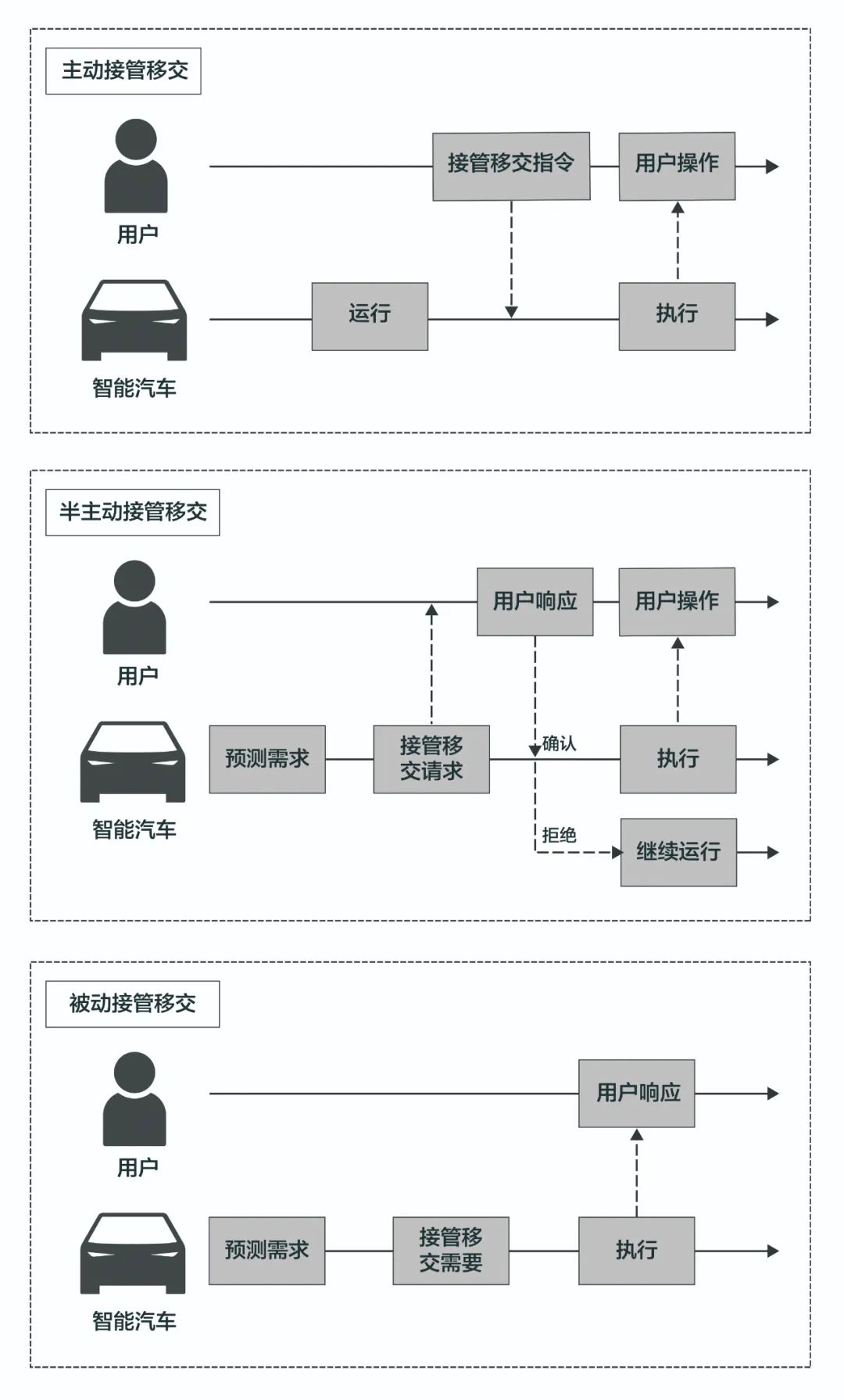

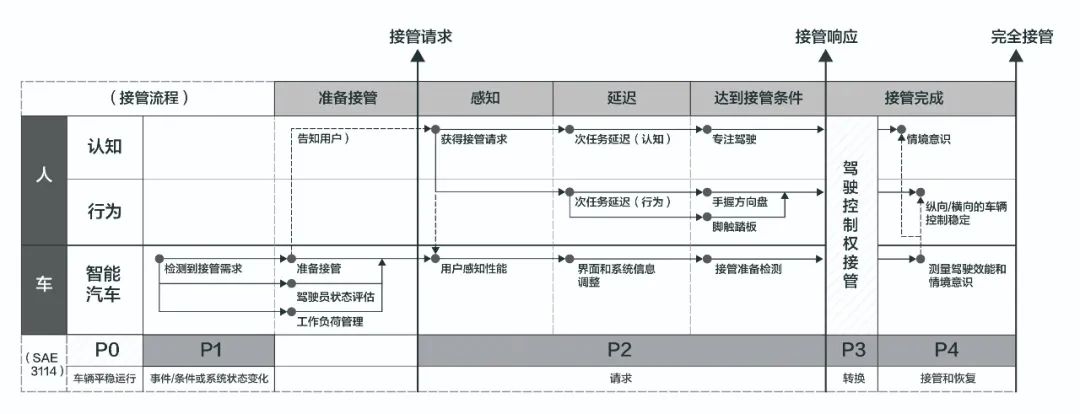

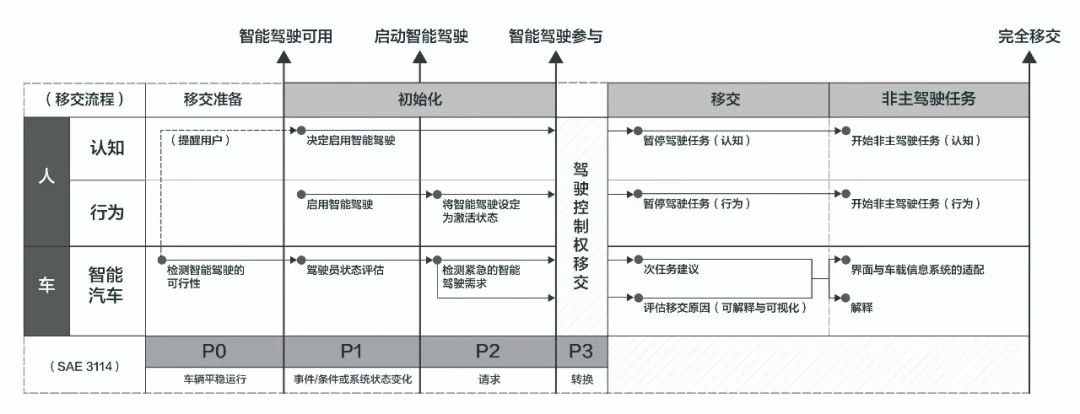

智能汽车的接管移交的交互流程按照交互主动性一般可以分为三种(图8):主动接管移交(Active Transition)指用户主动执行接管移交激活操作;半主动接管移交(Semi-active Transition)指系统先发起接管移交请求,需要用户进行确认/取消操作;被动接管移交(Passive Transition)指系统检测到汽车需要进行接管移交操作并直接执行。[15]特别需要说明的是,被动接管移交原则上只能移交给智能系统,因为在不告知用户的情况下直接将功能移交用户执行会带来情境意识和应急认知的问题,产生安全风险。除了主动性以外,事件紧急程度是接管移交流程设计的关键问题。在高紧急情境下,智能系统将承担更多的控制权,优先处理紧急事件。在接管移交过程中,可以将操作负荷、认知负荷较大的操作放在任务最后执行,避免同时出现过多的操作对用户安全感知体验带来不利影响。在低紧急情境下,用户不受紧急任务影响,在接管移交流程中可以加入用户的决策、选择等交互过程,提升用户对于智能汽车的控制感。

图8.智能汽车的接管移交的交互流程

从交互设计的角度看,控制权从智能汽车到人的接管流程设计最大的挑战在于情境意识的转变,因此在设计上,接管流程应该是逐步过渡的。由用户发起的接管流程设计的核心是在流程与交互设计中设置一个用户接管的行为或动作,如自适应定速巡航需要用户踩一下刹车,就自动切换到用户接管的状态。但是在自动驾驶的情境下,因为人不在环,因此可能需要由智能汽车主动发起接管流程。图9就是由智能汽车发起的接管流程图。首先,智能汽车根据情境感知发现并确认需要进行接管的需求,然后向用户发出接管请求。接管过程中,接管时间一方面必须足够长,以允许用户有足够的时间获得情境意识;另一方面接管时间也要足够短,以避免任务已经完成,用户还没有来得及处理,防止接管任务出现相关安全风险。在接管过程中,一旦用户意识到即将到来的转变,用户必须暂停正在进行的次要任务,包括认知和物理过程。同时,智能汽车的任务会进入人与智能汽车共同控制的状态,移交就开始了。当用户完全了解情况并开始执行驾驶任务时,整个移交结束,同时用户需要进行观察以评估车辆控制的安全性和稳定性。

图9.接管流程图(控制权从智能汽车到人)

(2)移交流程设计

与接管相比,移交的流程相对简单。移交既可以是用户发起的(可选的和强制的),也可以是智能汽车发起的。用户发起的移交,首先要用户通过控制设备告知智能机器,智能汽车需要对移交的安全性提出提示和限制。一旦智能系统获得了对驾驶功能的控制,就允许用户脱离功能执行。智能汽车发起的移交一般是出现了紧急的情况,而且用户很难快速处理,因此,必须自动地启动重要的安全系统。在这种情况下,一般需要在事后对车辆行为进行解释,如图10。

图10.移交流程图(控制权从人到智能汽车)

4

基于安全的智能汽车告警信息设计

在信息设计的层面,智能汽车的安全设计主要集中在对其告警信息的设计。从信息设计的角度说,包含告警信息的识别、理解和体验三个层面。

1.告警信息的可识别设计

车载声音显示因为具有直观、快速和实时性的特点,在汽车驾驶的情境下可以发挥告警作用,同时具有减少分心和视线偏移的作用,可以有效提升驾驶安全水平。在进行声音识别设计时,特别需要考虑声音的掩蔽和差别感觉效应等问题。同时,声音信息具有强烈的时间特性,对声音的反应时间会滞后0.2~0.5秒之间,这对于汽车驾驶情境具有一定的风险。因此,在进行告警声音交互设计时候,需要对声音信息进行时长的补偿设计,如提升信息延续时间等。例如,针对前面提及的情境意识的转变,通常需要考虑用户建立情境意识的时间,以便用户进行分析。但是,在智能驾驶的背景下,人们建立情境意识的时间会延长很多。费舍尔(Fisher S.)等的研究发现,用户意识到场景中潜在或迫在眉睫的危险所需的时间约为8秒。[17]莫克(Mok B. K. J.)等人的研究发现,在从事活跃的次要任务(在平板电脑上播放)后,需要5~8秒才能恢复对智能汽车的控制。[18]因此,如果出现了情境转变,则需要预留足够的情境意识建立和恢复的时间,这对于类似接管移交等人车交互的设计具有重要的意义。除了视觉和听觉显示外,触觉与实体交互也可以对告警信息进行显示,可以作为一种有效的显示手段。例如方向盘和座椅的振动都可以是告警信息显示的方式。

2.告警信息的可理解设计

告警信息内容的理解设计主要集中在信息内容结构设计上。信息内容的结构(framing)设计与信息本身的特点密切相关,形式多样,主要反映在信息内容的不同描述上。例如“有90%可能性会发生碰撞”和“有10%的可能性车辆不会发生碰撞”就是针对同一信息的不同的信息结构设计,对用户产生的影响是完全不同的。

汽车告警信息的智能决策可理解的核心在于,告知用户智能汽车做出决策的“黑箱”的信息和行为的原因和过程,主要集中在对算法的解释上。告警信息可解释设计在内容层面的具体设计方法,包括模型简化、局部解释、相关功能、举例说明等。(图13)通过简化的解释模型表示是最常用的解释方法之一。这种新的简化模型通常试图优化智能汽车告警功能与之前功能的相似性,同时降低其复杂性,并保持类似的性能指标。局部解释主要针对告警产生的属性(如环境因素)的描述进行解释,一般只能解释整个系统的部分功能。除此以外,通过告警决策的变量的关联评分来阐明模型的内部功能,即功能相关性。例如通过比较不同告警影响因素的变量之间的分数,可以解释当模型产生输出时候每个变量的重要性。举例说明的解释方法主要提取与某模型过程或者结果相关的数据示例,以便让人们更好地理解模型本身,其核心集中于提取具有代表性的例子。

图13.可理解设计中的智能行为的可解释模型

3.告警信息的体验设计

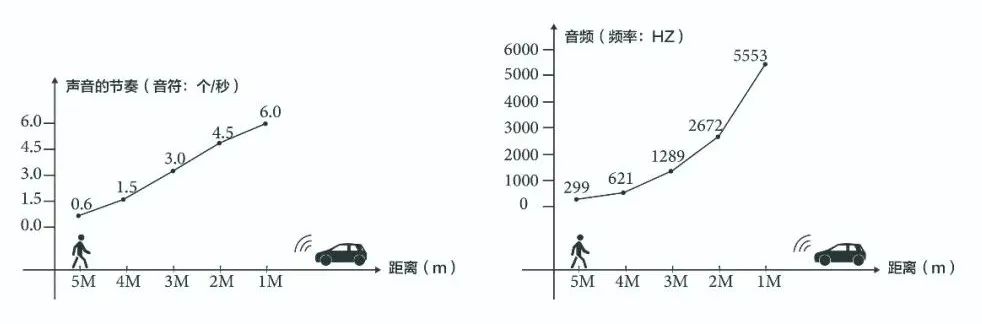

在声音显示层面,告警信息的声音也会根据具体情境(如紧急程度、任务性质等)改变音频、音高、音色等声音设计的要素,给用户产生不同紧急状态和不同任务的安全体验,以便更快地采取下一步的行动。如图15是湖南大学对汽车A柱盲区的告警信息的设计研究,研究发现用户很容易理解声音节奏和频音的增加表明了A柱离障碍物越来越近。

图15.A柱盲区的告警信息的设计研究(湖南大学,2021)

同样,在触觉交互中,告警提示的紧急程度也可以通过类似的操纵参数如基础频率、频率变化、振动强弱等来改变。

结语

智能汽车的安全问题是智能汽车设计的基本问题。随着智能汽车智能化程度的不断提升,人与智能汽车交互带来的安全问题还会快速增加,呈现多样化趋势。这使得基于人的因素的汽车信息与交互设计在智能汽车设计研发中扮演更加重要的角色。面向未来,要从根本上解决智能汽车信息与交互的安全设计问题,还需要将人与智能汽车置于整个交通系统甚至未来智慧城市中,围绕人、智能汽车、交通系统、社会文化所构成的混合系统开展进一步的设计研究,用设计去实现人类智慧出行的移动梦想。

[1] Urmson C, Anhalt J, Bagnell D, etal. Autonomous Driving in Urban Environments: Boss and the Urban Challenge[J]. Journal of Field Robotics, 2008, 8: 425.[2] Bonnefon JF, Shariff A, Rahwan I. The Social Dilemma of Autonomous Vehicles[J]. Science, 2016, 352: 1573.

[3] 张雷、刘凯威:《汽车研发中的重要环节——安全设计》[J],《装饰》,2009年第4期,第30-31页。

[4] 谭浩、谭征宇、景春晖:《汽车人机交互界面设计》[M],北京:电子工业出版社,2015,第55页。

[5] 李克强、戴一凡、李升波等:《智能网联汽车(ICV)技术的发展现状及趋势》[J],《汽车安全与节能学报》,2017年第8卷第1期,第1—14页。[6] Walker GH, Stanton NA, Young MS. Hierarchical Task Analysis of Driving: A New Research Tool[J]. Contemporary Ergonomics, 2001, 435: 40.[7] Endsley MR, Selcon SJ. Designing to Aid Decisions Through Situation Awareness Enhancement[C]. Proceedings of the 2nd Symposiumon Situation Awareness in Tactical Aircraft. Gold Canyon: SA Technologies, 1997: 107-112.

[8] 赵江洪、谭浩:《人机工程学》[M],北京:高等教育出版社,2006,第25页。[9] Simon HA. The Sciences of the Artificial[M]. Cambridge: MIT Press, 1969: 47.[10] Organization WH. Global Status Report on Road Safety 2018. Geneva: World Health Organization[M]. Geneva: World Health Organization, 2018.[11] Sae T. Definitions for Terms Related to Driving Automation Systems for On-Road Motor Vehicles. SAE Standard J, 2016, 3016: 2016.[12] 同[8],第61页。[13] 王建民、刘雨佳、李阳等:《基于态势感知的汽车人机界面设计研究》[J],《包装工程》,2021年第42卷第6期,第29-36页。[14] Zimmermann M, Bengler K. A Multimodal Interaction Concept for Cooperative Driving[C]. 2013 IEEE Intelligent Vehicles Symposium. (IV). Gold Coast: IEEE Press, 2013: 1285-1290.

[15] 吴超仲、吴浩然、吕能超:《人机共驾智能汽车的控制权切换与安全性综述》[J],《交通运输工程学报》,2018年第18卷第6期,第131-141页。

[16] 谭浩、孙家豪、关岱松等:《智能汽车人机交互发展趋势研究》[J],《包装工程》,2019年第40卷第20期,第32—42页。[17] Fisher S. Replan Understanding for Heterogenous Unmanned Vehicle Teams[D]. The United States: Massachusetts Institute of Technology, 2008.[18] Mok BKJ. Transitions of Control in Partially Autonomous Vehicles: Driver Response and the Design of Vehicle Interfaces[D]. The United States: Stanford University, 2017.

[19] 谭浩、张文泉、赵江洪等:《汽车交互界面视觉信息显示设计研究》[J],《装饰》,2012年第9期,第106-108页。

《装饰》杂志欢迎您的来稿

E-mail:zhuangshi689@263.net

地址:北京市海淀区清华园清华大学美术学院A431 中国装饰杂志社编辑部

电话:010-62798189 010-62798878

邮编:100084

官网:http://www.izhsh.com.cn

建议邮件 书信亦可

在微信中回复“投稿”即可获得投稿须知

投稿1.5月后可致电(010-62798878)查询初审结果

-

阅读原文

* 文章为作者独立观点,不代表数艺网立场转载须知

- 本内容由数艺网主动采集收录,信息来源为 “装饰杂志” 公开网络发布内容。第三方如需转载本内容,必须完整标注原作者信息及 “来源:数艺网”,严禁擅自篡改、删减或未标注来源转载。 并附上本页链接: 若您的内容不希望被数艺网收录,或认为此举侵犯了您的合法权益,敬请通过微信 ID:d-arts-cn 联系数艺网。我们将致以诚挚歉意,并第一时间为您办理下架或删除处理。