- 0

- 0

- 0

分享

- 2021级博士研究生王一立的论文被CIKM2022接收

-

原创 2022-08-08

人工智能学院王鑫助理教授指导的2021级博士研究生王一立的论文《AdaGCL: Adaptive Subgraph Contrastive Learning to Generalize Large-scale Graph Training 》(Full Paper)近日被 CIKM 2022 会议所接收。

王一立同学目前从事图神经网络相关的研究工作。本篇论文的第一作者是王一立同学,通讯作者是王鑫老师。其他合作者包括莱斯大学的Kaixiong Zhou博士以及佐治亚大学的Ninghao Liu老师。

文章详情

论文题目:

AdaGCL: Adaptive Subgraph Contrastive Learning to Generalize Large-scale Graph Training

第一作者:王一立

通讯作者:王鑫

收录会议:CIKM 2022

会议简介:第31届国际计算机学会信息与知识管理大会(The 31th ACM International Conference on Information and Knowledge Management, CIKM 2022)将于2022年10月17日至21日在美国亚特兰大举办。CIKM是CCF推荐的B类国际学术会议,是信息检索和数据挖掘领域顶级学术会议之一。

会议类别:CCF B 类会议

会议时间:Oct. 17-22, 2022, Atlanta, Georgia

论文概述:

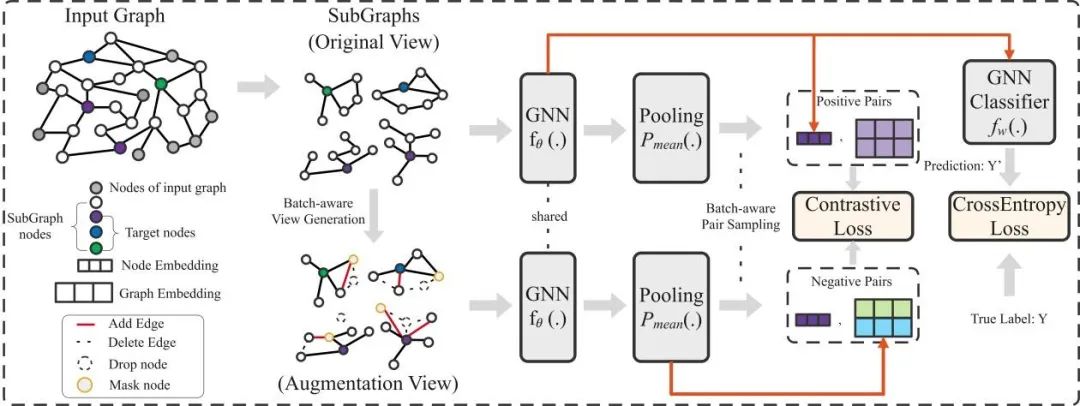

在大规模图上训练具有良好泛化能力的图神经网络(GNNs)是一个具有挑战性的问题。现有的方法主要是将大规模图分成多个子图,并在不同的批次中进行训练以提高模型的可扩展性。然而,与完整的图结构相比,通过这种策略得到的局部批次可能产生拓扑偏差。据研究,拓扑偏差会使训练阶段和测试阶段之间的性能出现更明显的差距,或者更差的泛化稳健性。一个直接的解决方案是利用对比学习,并通过数据增强来训练节点特征使其在不完整的训练图中具有鲁棒性和不变性。然而,大多数现有的工作都是在大规模图中对大量的节点对进行对比实验,效率较低。为了弥补大规模图训练和对比性学习之间的差距,我们提出了自适应子图对比学习(AdaGCL)。AdaGCL为批量训练定制了两个关键组件:(1)批量感知的视图生成,用来学习丰富的节点特征;(2)批量感知的配对采样,构建正负对比子图。

吉林大学|人工智能学院

吉林省长春市|吉林大学中心校区

正新楼|7F

-

阅读原文

* 文章为作者独立观点,不代表数艺网立场转载须知

- 本文内容由数艺网收录采集自微信公众号吉林大学人工智能学院 ,并经数艺网进行了排版优化。转载此文章请在文章开头和结尾标注“作者”、“来源:数艺网” 并附上本页链接: 如您不希望被数艺网所收录,感觉到侵犯到了您的权益,请及时告知数艺网,我们表示诚挚的歉意,并及时处理或删除。