“透过心智去探讨人工智能(AI)与人类心智的从过往的发展历史、当今的整合互动、到未来的可能”人工智能(AI)与人类心智从过往的发展历史、当今的整合互动、到未来的可能,两者密切复杂地相互影响。人类心智与AI的发展有什么样的关系?AI除了带来生活上的便利之外,如何影响我们的社会或心智?如何想象AI未来的样貌?本文将透过心智哲学观点切入探讨。

马斯克,脑机接口 图片来源:网络

The study of the mind

对于自身的探索是我们生命或是人类文明的重要一环。无论是基督教文化的灵魂观,或是佛学思想中的无我,我们都试着找寻能够解释各种形形色色心智面向的基础。当今的心智哲学与科学,便是延续它的探问。而此心智探索史与机器、电脑乃至AI的发展史相互交织与影响。

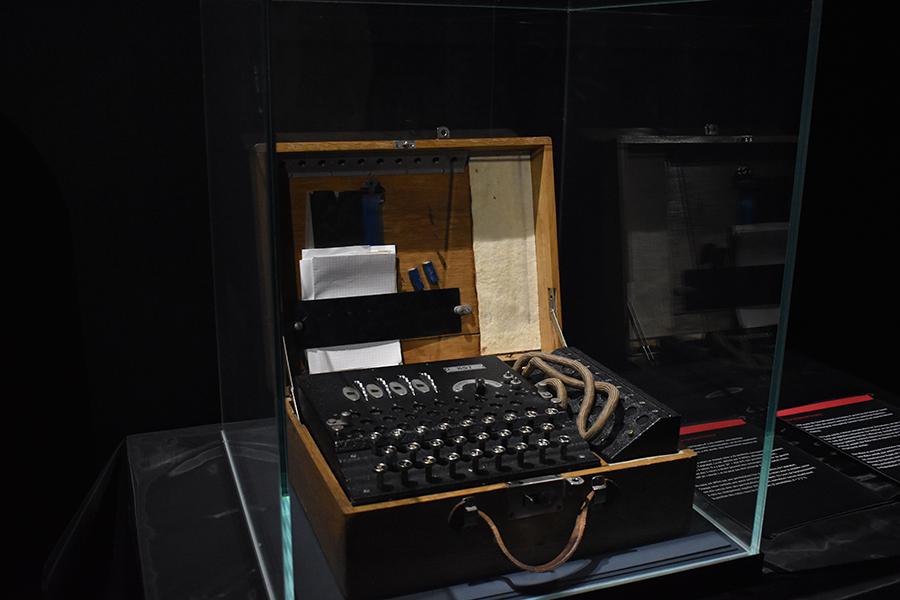

心灵或心智的本质是什么?关于心智的形而上学问题,西方心智哲学曾经给过的答案包括灵魂的存在或是以行为来理解。直到1930年代,图灵(Alan Turing)发明图灵算机(Turing Machine),机器依循规则进行简单的符号操弄,而展现各式各样的功能(Turing, 1936)。规则或程序可用四元函数来简单表示:(Si, Ij, Ok, Sl),让机器知道若是在 Si 状态,且遇到输入Ij,则该执行什么样的动作或输出(Ok),并进入哪一个机器状态(Sl)。从简单的加法到更为复杂的计算,可以用特定的图灵算机来完成。大家目前使用的计算机所采用的基础原理便是图灵算机。

除了发明图灵算机,图灵(1950)也探索心智的问题。他提问道:机器能思考吗?理论上,电脑是否可能透过有限的指令或程序,展现出类似人类思考的行为反应,甚至不被人发现它只是一台电脑?

后者的测试即为「图灵测试」(Turing test)。受到图灵的启发,哲学家普特南(Hilary Putnam)(1960, 1967)提出了以机器状态来理解心智状态的想法。此观点开启之后功能论(functionalism)的发展,由功能性观点来理解心智。

Enigma,由Alan Turing发明的加密机器 图片来源:网络

The development of AI

计算机的发明启发了心智的功能理论,另一方面,人类的心智运作也回过头来启发电脑和人工智能的发展。从罗森布拉特(Frank Rosenblatt)(1958)所发展出的模仿人类视觉运作的感知器(perceptron)神经网络,到罗森布拉特、辛顿(G. E. Hinton)与威廉斯(R.J. Williams)(1986)提出三层网络的学习算程,到现今当红的深度学习,其运作原理模拟生物神经系统,由单元(unit)相互联结组成。经过训练而改变联结的强度,让神经网络自动学会输入和输出之间的关系,而得以展现某项功能。随着硬件运算能力提升,透过更复杂和庞大的类神经网络设计,让我们经常惊艳于AI科技能力的发展,包括协助选才中的公司筛选应征者、自驾车的视觉辨识系统、医疗上辨识放射图中的肿瘤,以及协助司法系统进行审判等等。

摄影:Aideal Hwa On Unsplash 图片来源:网络

Convenience of life

当代AI科技在社会中的参与数不胜数,包括代替人类进行部分的决策或参与决策历程,例如辅助法官判案的AI,可帮助避免人类法官在判案时可能产生的标准不一致的状况。研究显示,法官的血糖值与饥饿程度,将会大幅影响其判决的标准,进而造成判决不公的疑虑(Danziger, Levav, & Avnaim-Pesso, 2011)。

辅助判决的AI应用便能给予法官一个不受饥饿程度影响的判决建议,帮助法官避免噪声(noise)影响决策结果(Kahneman, Sibony,& Sunstein,2021)。

从这个例子中可以发现,AI科技确实对社会有好的影响;但同时,这并不代表AI的判断就是全然公正的。

2016年12月,一名新西兰华裔在在线申请护照时,总是无法通过审核。在与相关部门反应后,经调查发现,这是因为照片审核AI系统将照片中眼睛小的他判定为「未张眼」,因此无法通过审核;这照片审核AI的判断标准对眼睛普遍较小的族群是有所偏误的。同样地,美国过去使用的视觉辨识AI也有较难辨识出黑人女性的偏误存在。这类偏误使得某些族群较难、或甚至无法取得应得的资源。分配正义和歧视的问题油然而生。

电路图 图片来源:网络

Bias of AI

有偏误的AI判断标准如何产生?AI进行判断时所使用的标准,是透过人类给予的过往认知判断数据塑造而成。换句话说,AI是以人类过往的认知判断史为学习对象。若该判断史本身便是由带有偏误的过往判断建构而成,则AI也难以避免地学习了这些偏误。

过往的判断史多由人类的主流社群决定,体现了人类的集体价值、观点。但所谓的集体价值、观点,实际反映的也只是主流意见,而忽略了边缘化群体的声音。

由这样的判断史所塑造的社会模式,势必会有不利于、或甚至压迫某些边缘化群体的偏误参杂其中。使用AI虽能避免判断当下因生理和心理状况而发生偏误,却仍旧躲不开已然嵌入历史、并被AI内化的偏误继续介入社会当中。难道我们没有可能做得更好吗?

AI偏误的问题目前已在相关学界被讨论得沸沸扬扬,也唤起AI设计人员与公司的注意。AI无法发现自身判断的偏误进而修正,主要的原因在于AI是透过「事实」学习;发生过的判断数据中有什么模式(pattern),AI就将之学习起来。但论及偏误时,我们常谈的是「应该」,AI决策结果「应该」要公正。然而,AI无法单靠被给予的事实数据与自身算法就学习到人类社会追求的「理想」价值,反而会学习到人类在经意或不经意的状况下展现的价值判断。这些价值应该如何实践在AI身上?包括如何进行数据搜集和清理,确保判断资料的多元性?如何检视算法的使用是否适当?什么样的结果才能称得上是公正的,且符合边缘化群体价值?如何带入各利益关系人和不同族群的观点,培养出符合社会正义的AI?这些是落实价值的难题(Fazelpour & Danks, 2021)。然而,即便我们在某种程度上降低AI的偏误,这仍旧是治标不治本的方法。AI终究是从人类决策中学习到偏误,只要人类社会存有偏误,我们就难以保证AI没有学习到偏误的可能。不过,也许不需要如此悲观,我们能够从另一种观点看待AI能提供人类社会的贡献。AI是不是能够协助降低人类的偏误或是这些偏误所带来的伤害呢?人类偏误的运作是自动化且迅速的,总是潜伏在意识与无意识的边界之间,时常在不经意的情况下介入认知判断,而在事后反思时才能发现(Brownstein, 2018)。

即使人类仍有许多训练手段能降低认知偏误,但效果有限。当代AI科技的功能不只与人类的认知能力相似。AI介入人类的认知工作如此之深,在相互影响下,两者可被视为嵌合而成的认知系统。针对人类偏误的问题,AI 能够帮忙。透过将 AI 设计为人类认知的延伸(Clark & Chalmers, 1998),一同塑造认知历程,AI能协助人类了解和侦测自身偏误的自动化运作,甚至在适当的时机进行提醒或介入,协助人类进行判断较不受偏误影响的决策过程 (Lin, Hung, & Huang, 2020)。如此的辅助AI成为人类心智的一部分,那么AI本身是否可能有心智呢?AI能有什么样的心智?

Ai's understanding

虽然多数研究聚焦在研发服务人类的AI,AI能够展现出什么样的心智面向也是常受到关注的议题。例如:人工系统是否可能像人类一样「理解」或「感受」呢?这反映在人类对于人工意识(artificial consciousness)(Metzinger, 2013)或是超级智能(superintelligence)(Bostrom, 2014) 的忧虑上。哲学家希尔勒(John Searle)提出中文房间的思想实验(Searle, 1980):假设小明待在一个房间里面,他完全不懂中文,但这间房间里面有一本规则书,让小明知道收到什么样的输入,应该输出什么样的讯息。如果小美拿着一张纸条写着「你好吗?」丢进房间里,而小明可以根据这几个字的样子,在规则书中找到要回复「我很好,你呢?」给小美。对于不知道房间内部运作的小美而言,她会以为在房间里的人是懂中文的,然而事实上,小明只是根据真正懂中文的人所订下的规则,去完成聊天的任务而已。希尔勒试图提出此思想实验挑战功能论,后者以依循规则的方式理解认知运作,无法解释人类所具备的「理解」经验或能力。他的攻击也一起挑战了计算机能够「理解」的可能性。要了解AI是否能像我们一样具备「内在小剧场」或「心理世界」,问题又更为复杂了,而且类似的问题也展现在动物意识问题上。

我们会说狗具有视觉意识,因为牠们眼睛构造、知觉处理、神经系统等跟人类足够相似,也因为外在的刺激而展现相对应的行为。在动物心智的研究,不外乎是透过动物的讯息处理系统的运作,或是展现出来的行为表现,来推论某类生物是否有意识或是某种心智能力。然而,这样的推论方式,可运用在与人类猫狗、猩猩等与人类接近的生物。然而有些落在中间的动物,像是昆虫或是鱼类,学者的观点以及我们的直觉就开始分歧了。针对与人类差异太大的生物,单就系统的运作和行为的判断,无法成功取得共识。

人工智能(AI)机器人 图片来源:网络

The face of AI

而当我们在探讨什么样的AI系统是否能具有内在心智或意识时,也面临同样的知识论挑战。即便我们先姑且接受功能论的立场,接受意识或其他心理面向有可能在人工系统上实现,但要了解什么样的系统才能展现。需要什么样的特殊结构或运作?需要多复杂?需要多么类似人类?类似人类系统运作的哪些面向?需要能够展现出什么样复杂的行为表现?就如同动物心智研究面临的问题,透过探讨底层的认知运作,或是外在的行为表现,我们都无法确认AI是否真的有内在世界,还是只是像中文房间一样,具备复杂的运作规则,且能给予适当的回应。我们和机器一路走来,相互「学习」和影响。想象我们和 AI 的未来为何,除了我们对于未来无法完全掌握所带来的未知,还有机器在知识上隔绝于我们的不可知。

电影《模仿游戏》(The Imitation Game)重现图灵机

图片来源:网络

关于作者

王奕然为国立阳明交通大学心智哲学研究所硕士生。研究兴趣包含心智哲学、认知科学、应用伦理学、美学与艺术哲学。

邱少齐为国立台湾大学哲学系学士毕业,现为国立阳明交通大学心智哲学研究所硕士生,研究兴趣包含意识研究、心理学、后设哲学。林映彤为国立阳明交通大学心智哲学研究所副教授,德国古腾堡大学(Johannes Gutenberg University Mainz)哲学博士。专长领域为心智哲学、意识研究、神经伦理学、AI 哲学。