- 0

- 0

- 0

分享

- CS2020-07数字媒体项目-AI虚拟数字人“小影”的“前世今生”

-

原创 2020-09-23

项目背景

虚拟角色

虚拟角色起源于影视CG行业,比如《指环王》系列电影中由安迪·塞基斯动作捕捉扮演的“咕噜”,《猩球崛起》中的主角“凯撒”,无不使用了当时最先进的虚拟角色技术。

《猩球崛起》虚拟数字角色“凯撒”

但是这些镜头中的每一帧画面都是花费数小时甚至几十个小时渲染出来的,成本高昂,早期的虚拟角色技术主要应用在影视工业中。

实时虚拟角色

随着游戏引擎等实时技术的快速发展,从Epic Games与数字王国合作开发的实时数字面部捕捉技术,到Facebook公布Codec Avatars技术,再到腾讯携手Epic开发虚拟数字人物,实时虚拟角色逐渐得以实现。

腾讯、Epic Games、Cubic Motion和3Lateral联合打造实时虚拟人物“Siren”

虚拟角色的所有动作表情都由实时捕捉以及实时渲染形成。操作者需要将一套特制的设备戴在头上,这一设备会实时跟踪多个面部特征点,再把这些特征点实时反映到基于扫描构建的人物模型上,最终呈现为以每秒60帧输出的动作和表情。

制作过程

"小影"的初步想法源自于公司内部的一次展示,当时希望向客户展示公司之前一个项目里面的数字角色,但是这个角色并非实时,交互部分是通过代码组织多个已渲染好的序列实现的,角色的对话和反应都是事先设定好。

由此我们想到,是否可以让一个虚拟人物实时跟人对话和互动呢,这需要结合人工智能技术,想到就做,随后我们就开始了技术方面的探索,这就是AI虚拟数字人“小影”的雏形。

“小影”1.0版本

经过一段时间的开发,“小影”1.0基本达到了最初的构想,实现了基本互动、智能对话、口型驱动等,但是看起来还是不太自然,为了达到更加自然的效果,我们决定开发“小影”2.0版本。

“小影”2.0版本

“小影”2.0的开发上,我们重新构建了人物模型,增加3S材质效果,实时布料解算,在交互层面,情绪分析的功能也得以加强,一个眼神、一个微笑……像这些小小的细节,都会大大加强数字人物的真实度。

核心技术

3D角色模型 ·

虚拟数字人的基础是人物模型的构建,后续的一系列开发都在基础的模型上展开,所以这方面的制作起着决定性的作用。

对于写实风格的虚拟人物,一般的制作流程如下:

静态人物扫描→人物模型拓扑→Lookdev外观开发→身体及面部骨骼绑定→口型及基本动作设置

智能无限制语音对话 ·

提到智能语音对话,当前的绝大多数互联网和智能手机厂商都拥有人工智能助手,可提供实时的对话功能,这里包括有苹果的Siri、微软的Cortana、小米的小爱同学等。AI智能虚拟人同样不例外,她的灵魂就在于能够实时的跟人进行对话,能听明白提问者的意思,能表达自己的观点。

我们的语音对话技术采用领先的人工智能语音识别技术,基于增强学习模型,能够达到接近真人的聊天对话体验,开放域聊天准确率81.64%,垂域技能准确率96.34%,千万级实体及关系知识,支持逻辑与关系的知识推理。

重要的是,我们也可以根据客户要求和角色设定,选择合适的音色,深度定制回答机制,通过关键词、语义相似度模型打造专属技能,逐步赋予每个虚拟数字人唯一的性格特征。

实时口型驱动 ·

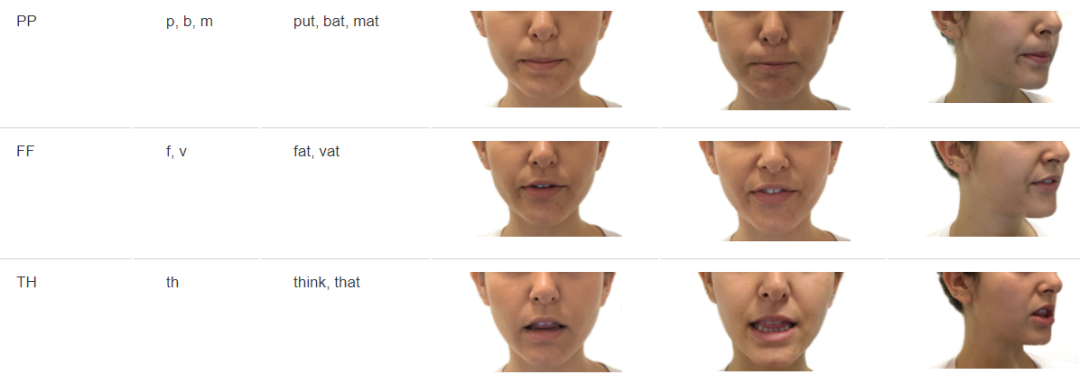

要做到语音实时驱动口型,需要先研究人类的基本发音口型,在模型阶段设置好口型的Blendhape。

以下是部分发音的基本口型示例,“小影”的所有口型动作就是基于这些参考来制作。

有了基础口型,接下来就可以进行语音实时驱动。通过上述智能对话系统获得的音频片段,在Unity中经过Oculus Lipsync的实时波形分析和驱动技术,可以使口型跟随音频以较低延迟输出,达到观感上接近同步地实时口型驱动效果。

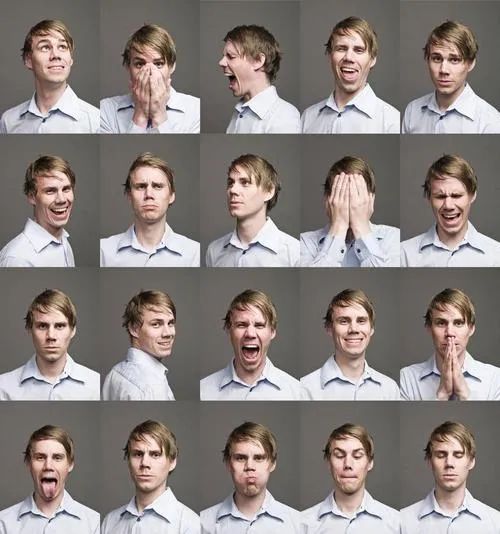

基于情绪的表情控制 ·

让虚拟人只是开口讲话还是远远不够的,人类作为灵长类,拥有远超其他动物的表情和微表情系统,为了尽可能地模拟人类的表情,我们为“小影”深度开发了基于情绪的表情管理系统。

仔细观察会发现,人类在对话时会伴有表情,这个表情并不是随机的,而是当下情绪的一种表达。

比如当有人夸你的时候,你会自然地做出开心的表情,当听到让人难过的事情时,你也会不自觉地皱眉。

那怎样去实现呢?AI智能虚拟人的表情控制需要包含以下几个模块。

1、人工智能情绪分析系统:返回情绪关键词

2、表情动作库:提供高兴、开心、厌恶、难过等丰富的表情库

3、表情融合表达系统:通过情绪关键词实时地调用表情库,并控制表情融合,输出给虚拟人

实时动作交互 ·

除了实时对话,AI虚拟数字人同样需要对人的动作做出肢体的反应,比如看到有人在打招呼,应该做出点头示意或者招手的动作。

要有这些动作交互,就需要让虚拟人看到我们,这就需要利用到深度摄像头的相关硬件和技术。

在“小影”项目中,我们采用的是微软的Azure Kinect DK,配有先进 AI 传感器的开发人员工具包,用于计算机视觉方面的开发。

注视、眼镜跟随:当用户靠近时,虚拟人能够意识到并转头朝向用户,注视对方,实时跟随。

动作识别和反应:设置一些互动的手势和动作,当用户做出这些动作时,虚拟人实时做出合适的反应动作。

特殊指定动作:比如赋予虚拟人才艺,可以在系统中设置唱歌、跳舞、讲段子等指定动作,通过指定的关键词触发。

应用场景

智能导购

通过强大的信息库,我们的AI虚拟数字人能够解决顾客/游客想要知道商品或商家的问题以及想要去的地方,同时也能和顾客/游客亲切的交流,你想知道的任何问题,她都能随时回答你。

智能生活

通过强大的信息库,我们的AI虚拟数字人能帮助你解决生活中的无聊,工作上的难题,开心生活的同时便捷工作。

智能教育

通过线上教学/教导,我们的AI虚拟数字人在实施教学的同时还能跟学习者产生互动,实时解决学习者当时的困惑,真正做到人性化教学。

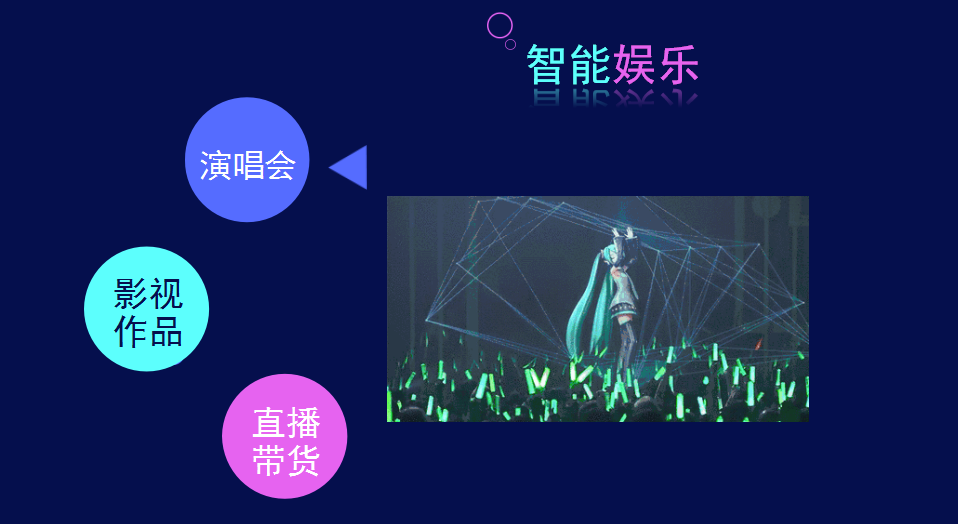

智能娱乐

通过唱歌、跳舞、演戏、主持等才艺,我们的AI虚拟数字人在演唱会里,可以是万丈光芒的idol,在影视作品里可以是演戏惟妙惟肖的戏骨,在直播带货中可以是口才了得的UP主。

智能医疗

通过充当医疗机器人,帮助人们修复人类受损身体,让人们得到康复,我们的AI虚拟数字人也可以进行药物研发,还可以让AI虚拟数字人进行学习专家医生的医疗知识之后,进行智能诊疗,给出可靠诊断和治疗方案等。

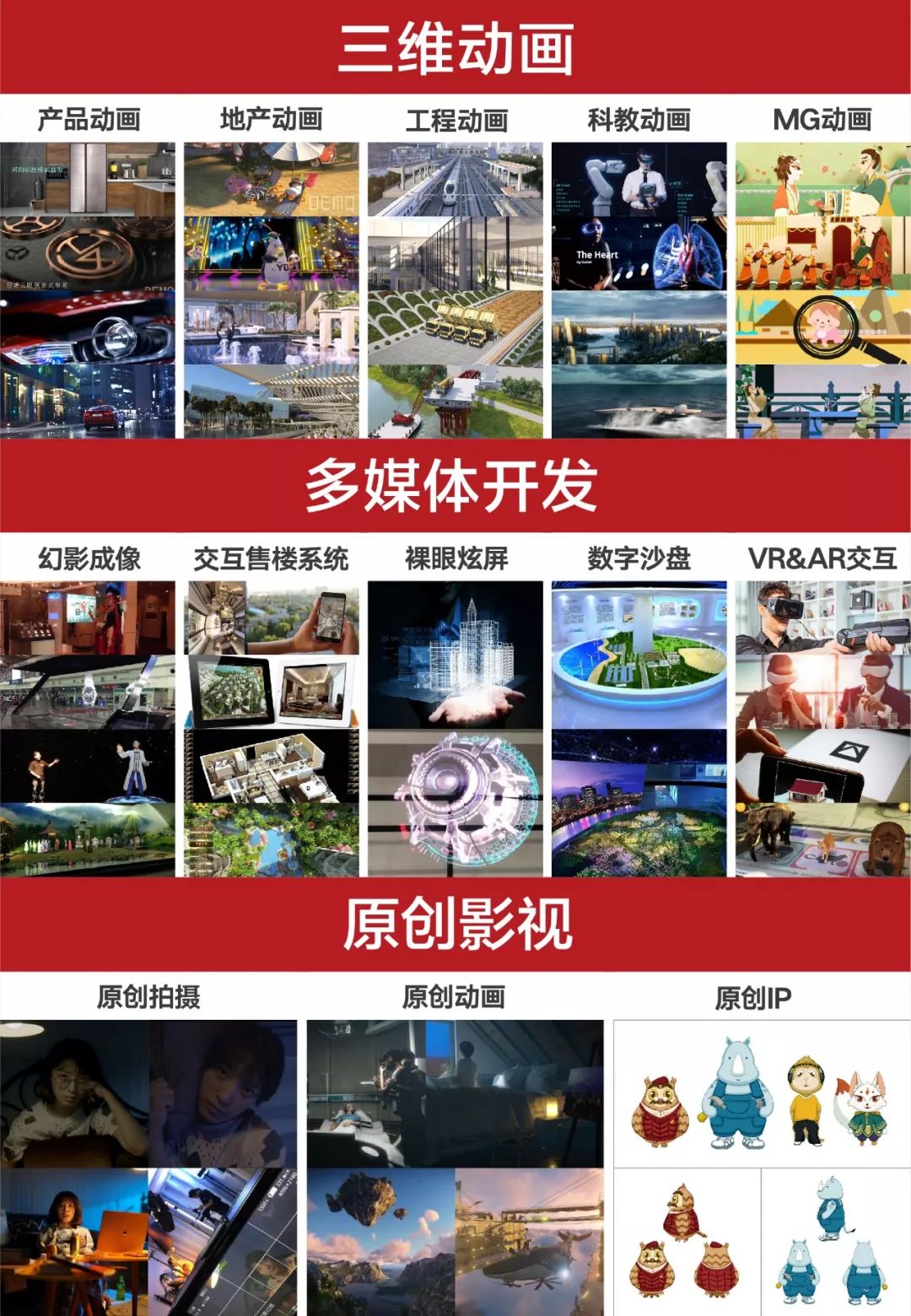

正映专业制作

建筑投影、全息投影、幻影成像、裸眼炫屏等

多媒体开发技术

剖析产品内核,深挖品牌价值

正映为企业打造更具创新

更加多元化的数字媒体解决方案

★主营业务★

正映是一群致力于将数字科技和动漫创意相结合的团队

坚持在具有中国特色cg艺术的道路上不懈努力

——唯有赋予灵魂,方能见证永恒——

-

阅读原文

* 文章为作者独立观点,不代表数艺网立场转载须知

- 本内容由数艺网主动采集收录,信息来源为 “正映影视” 公开网络发布内容。第三方如需转载本内容,必须完整标注原作者信息及 “来源:数艺网”,严禁擅自篡改、删减或未标注来源转载。 并附上本页链接: 若您的内容不希望被数艺网收录,或认为此举侵犯了您的合法权益,敬请通过微信 ID:d-arts-cn 联系数艺网。我们将致以诚挚歉意,并第一时间为您办理下架或删除处理。